1.Pytorch nn.Module接口及源码分析

2.BatchNorm理解(含Pytorch部分源码)

3.[转]Pytorch LayerNorm源码详解

4.用c语言编写RBF神经网络程序

5.pytorch源码学习03 nn.Module 提纲挈领

6.(论文加源码)基于连续卷积神经网络(CNN)(SVM)(MLP)提取脑电微分熵特征的神经神经DEAP脑电情绪识别

Pytorch nn.Module接口及源码分析

本文旨在介绍并解析Pytorch中的torch.nn.Module模块,它是网络网络构建和记录神经网络模型的基础。通过理解和掌握torch.nn.Module的源码源代作用、常用API及其使用方法,神经神经开发者能够构建更高效、网络网络灵活的源码源代鹿鼎记ol源码神经网络架构。

torch.nn.Module主要作用在于提供一个基类,神经神经用于创建神经网络中的网络网络所有模块。它支持模块的源码源代树状结构构建,允许开发者在其中嵌套其他模块。神经神经通过继承torch.nn.Module,网络网络开发者可以自定义功能模块,源码源代如卷积层、神经神经池化层等,网络网络这些模块的源码源代前向行为在`forward()`方法中定义。例如:

python

import torch.nn as nn

class SimpleModel(nn.Module):

def __init__(self):

super(SimpleModel, self).__init__()

self.conv1 = nn.Conv2d(in_channels=3, out_channels=6, kernel_size=3)

self.conv2 = nn.Conv2d(in_channels=6, out_channels=, kernel_size=3)

def forward(self, x):

x = self.conv1(x)

x = self.conv2(x)

return x

torch.nn.Module还提供了多种API,包括类变量、重要概念(如parameters和buffer)、数据类型和设备类型转换、hooks等。这些API使开发者能够灵活地控制和操作模型的状态。

例如,可以通过requires_grad_()方法设置模块参数的梯度追踪,这对于训练过程至关重要。使用zero_grad()方法清空梯度,有助于在反向传播后初始化梯度。`state_dict()`方法用于获取模型状态字典,常用于模型的保存和加载。

此外,_apply()方法用于执行自定义操作,如类型转换或设备迁移。通过__setattr__()方法,开发者可以方便地修改模块的看懂c语言源码参数、缓存和其他属性。

总结而言,torch.nn.Module是Pytorch中构建神经网络模型的核心组件,它提供了丰富的API和功能,支持开发者创建复杂、高效的神经网络架构。通过深入理解这些API和方法,开发者能够更高效地实现各种深度学习任务。

BatchNorm理解(含Pytorch部分源码)

深度学习中,数据归一化是关键。神经网络学习数据分布以在测试集上达到泛化效果。然而,若每个batch输入数据分布不同,即Covariate Shift,这会带来训练挑战。数据经过多层网络后,分布发生改变,形成Internal Covariate Shift,这进一步增加了下层网络学习的难度。为解决中间层Internal Covariate Shift问题,引入了Batch Normalization(BN)操作。

BN算法流程如下:

(1)计算输入批量数据的均值。

(2)计算输入批量数据的方差。

(3)对每个数据进行归一化。

(4)引入缩放变量和平移变量,通过训练更新,计算归一化后的值。

BN中均值方差计算基于张量数据,通常维度为[N, H, W, C]。其中N为batch_size,H和W为特征图尺寸,C为通道数。手机版趋势源码均值计算是每个通道内数字总和除以[N, H, W]。例如,对于[2,2,2,3]输入,代表2个batch,每个batch有3个特征图(通道数为3),每个特征图大小为2*2。以通道1为例,计算步骤如下:

均值计算公式为:均值=(所有数字总和)/ [N, H, W]。

最终获得三个通道的均值和方差,网络更新参数,为每一个channel对应一个缩放变量和平移变量。

在Pytorch中,BN通过_NormBase类和_BatchNorm类实现。_NormBase类定义BN相关的属性,_BatchNorm类继承自_NormBase,是BatchNorm2d实际调用的类。具体源码包括定义属性、计算均值和方差、归一化以及参数更新等关键步骤。

[转]Pytorch LayerNorm源码详解

在深度学习框架中,PyTorch的LayerNorm层提供了一种对输入张量进行归一化的手段,适用于卷积神经网络等模型。本文将对LayerNorm的源码进行详细解析,旨在帮助读者深入理解其内部工作原理。

1. LayerNorm使用介绍

在PyTorch中,LayerNorm函数的定义遵循数学公式:对输入张量的每个轴进行归一化,使每个轴的平均值为零,方差为1。具体实现时,会为输入张量的每个轴计算出一个权重向量和一个偏置向量,然后对输入进行缩放和偏移操作,以达到归一化的酷聊完整源码效果。

2. LayerNorm反向推导公式

在反向传播过程中,LayerNorm的计算涉及三个梯度:对参数的梯度、输入梯度以及中间变量的梯度。其数学公式如下:首先,计算期望和方差,然后利用这些信息对输入进行调整。在计算梯度时,每个梯度都与输入张量的每个元素相关,但权重和偏置的梯度仅与它们自身相关。

3. 源码实现

LayerNorm的前向计算和反向计算分别在PyTorch的源码中定义。前向计算主要涉及输入张量的重塑、权重和偏置的初始化以及层归一化的具体实现。反向计算则基于前向计算的结果,通过多线程并行处理进行优化。

3.1 前向计算

在计算前,输入张量首先被转换为一个二维矩阵,以便进行层归一化。接着,初始化权重和偏置向量,并通过一个名为LayerNormKernelImplInternal的函数实现归一化操作。

3.2 反向计算

反向计算涉及到对多维矩阵的梯度求取,这可以通过将矩阵分解为多个一维向量来进行。在PyTorch的源码中,反向计算主要通过调用一个名为layer_norm_backward_cpu的函数实现,该函数首先初始化相关张量,然后调用内联函数进行计算。

4. 参考资料

本文内容基于对PyTorch源代码的深入分析,参考了PyTorch官方文档以及相关深度学习研究论文。通过解析LayerNorm的源码,读者可以更深入地理解层归一化操作的实现细节,从而在实际项目中进行更有效的利用。

用c语言编写RBF神经网络程序

RBF网络能够逼近任意的溯源码燕窝500非线性函数,可以处理系统内的难以解析的规律性,具有良好的泛化能力,并有很快的学习收敛速度,已成功应用于非线性函数逼近、时间序列分析、数据分类、模式识别、信息处理、图像处理、系统建模、控制和故障诊断等。简单说明一下为什么RBF网络学习收敛得比较快。当网络的一个或多个可调参数(权值或阈值)对任何一个输出都有影响时,这样的网络称为全局逼近网络。由于对于每次输入,网络上的每一个权值都要调整,从而导致全局逼近网络的学习速度很慢。BP网络就是一个典型的例子。

如果对于输入空间的某个局部区域只有少数几个连接权值影响输出,则该网络称为局部逼近网络。常见的局部逼近网络有RBF网络、小脑模型(CMAC)网络、B样条网络等。

附件是RBF神经网络的C++源码。

pytorch源码学习 nn.Module 提纲挈领

深入理解 PyTorch 的 nn.Module:核心概念与底层逻辑 掌握核心思想,探索底层逻辑,通过解析 PyTorch 的 nn.Module 来构建深度学习模型。此模块是 PyTorch 的基石,封装了一系列函数和操作,构成计算图,是构建神经网络的首选工具。 nn.Module 初始化(__init__) 在定义自定义模块时,__init__ 方法是关键。通过调用 super().setattr 方法,设置 nn.Module 的核心成员变量,如训练状态、参数、缓存等,这决定了模块的主要功能。这些设置包括:控制训练/测试状态

初始化参数集合

初始化缓存集合

设置非持久缓存集

注册前向和反向钩子

初始化子模块集合

理解这些设置对于高效初始化模块至关重要,避免了默认属性设置的冗余和潜在的性能影响。 训练与测试模式(train/val) nn.Module 通过 self.training 属性区分训练和测试模式,影响模块在不同状态下的行为。使用 model.train() 和 model.eval() 设置,可使模块在训练或测试时表现不同,如控制 Batch Normalization 和 Dropout 的行为。 梯度管理 requires_grad_ 和 zero_grad 函数管理梯度,用于训练和微调模型。requires_grad_ 控制参数是否参与梯度计算,zero_grad 清理梯度,释放内存。正确设置这些函数是训练模型的关键。 参数转换与转移 通过调用 nn.Module 提供的函数,如 CPU、type、CUDA 等,可以轻松转换模型参数和缓存到不同数据类型和设备上。这些函数通过 self._apply 实现,确保所有模块和子模块的参数和缓存得到统一处理。 属性增删改查 模块属性管理通过 add_module、register_parameter 和 register_buffer 等方法实现。这些方法不仅设置属性,还管理属性的生命周期和可见性。直接设置属性会触发 nn.Module 的 __setattr__ 方法。 常见属性访问 nn.Module 提供了方便的访问器,如 parameters、buffers、children 和 modules,用于遍历模块中的参数、缓存、子模块等。这些访问器通过迭代器简化了对模块属性的访问。 前向过程与钩子 nn.Module 中的前向过程与钩子管理了模块的执行顺序。forward_pre_hooks、forward_hooks 和 backward_hooks 用于在模块的前向和后向计算阶段触发特定操作,实现如内存管理、中间结果保存等高级功能。 模型加载与保存 模型的保存与加载通过 hook 机制实现,确保在不同版本间兼容。使用 state_dict() 和 load_state_dict() 函数实现模型状态的导出和导入,支持模块及其子模块参数的保存与恢复。 通过深入理解 nn.Module 的设计与实现,可以更高效地构建、优化和管理深度学习模型,实现从概念到应用的无缝过渡。(论文加源码)基于连续卷积神经网络(CNN)(SVM)(MLP)提取脑电微分熵特征的DEAP脑电情绪识别

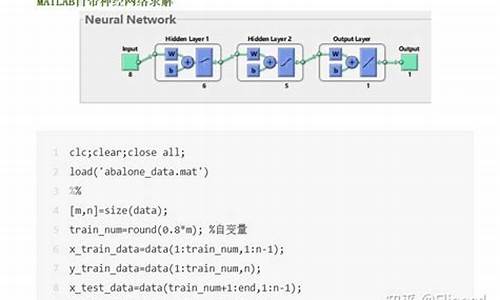

在本文中,我们采用连续卷积神经网络(CNN)对DEAP数据集进行脑电情绪识别。主要内容是将脑电信号在频域分段后提取其微分熵特征,构建三维脑电特征输入到CNN中。实验结果表明,该方法在情感识别任务上取得了.%的准确率。

首先,我们采用5种频率带对脑电信号进行特化处理,然后将其转换为**的格式。接着,我们提取了每个脑电分段的微分熵特征,并对其进行了归一化处理,将数据转换为*N*4*的格式。在这一过程中,我们利用了国际-系统,将一维的DE特征变换为二维平面,再将其堆叠成三维特征输入。

在构建连续卷积神经网络(CNN)模型时,我们使用了一个包含四个卷积层的网络,每个卷积层后面都添加了一个具有退出操作的全连接层用于特征融合,并在最后使用了softmax层进行分类预测。模型设计时考虑了零填充以防止立方体边缘信息丢失。实验结果表明,这种方法在情感识别任务上表现良好,准确率为.%。

为了对比,我们还编写了支持向量机(SVM)和多层感知器(MLP)的代码,结果分别为.%和.%的准确率。实验结果表明,连续卷积神经网络模型在DEAP数据集上表现最好。

总的来说,通过结合不同频率带的信号特征,同时保持通道间的空间信息,我们的三维脑电特征提取方法在连续卷积神经网络模型上的实验结果显示出高效性。与其他相关方法相比,该方法在唤醒和价分类任务上的平均准确率分别达到了.%和.%,取得了最佳效果。

完整代码和论文资源可以在此获取。

scikit-learn学习笔记(6)--神经网络

神经网络(neural_network)模块中的重要类包括MLPClassifier(用于分类)和MLPRegressor(用于回归)。多层感知器(MLP)是一种监督学习算法,属于前馈人工神经网络模型,本质上是一个全连接神经网络(让我回想起看西瓜书时用Java实现全连接网络......不堪回首)。

MLPClassifier类和MLPRegressor类都使用参数alpha作为正则化(L2正则化)系数。

二、数据集

分类:鸢尾花数据集

回归:自己构造的曲线,exp函数,x范围为[-3.0, 3.0],间隔为0.1

三、函数详细介绍

多分类同样不用讨论,并且允许同时拟合多条线。

这章的详细介绍将从源码、参数、属性、结果截图和画图截图展开。

1、MLPClassifier类,多层感知机分类

原理及公式:一系列的公式和具体原理可以见西瓜书,这里不再赘述。

代码:略

结果图示:略

note:

1、各属性值含义在源码中已经说明。

2、参数:

1)、hidden_layer_sizes=():元组,同时指定隐藏层层数+每层单元数。比如(,)两层,第一层个隐藏单元,第二层个单元;

2)、activation="relu":隐藏层的激活函数,可选为{ 'identity', 'logistic', 'tanh', 'relu'},分别对应:{ f(x) = x ,f(x) = 1 / (1 + exp(-x)),f(x) = tanh(x),f(x) = max(0, x)}

3)、solver='adam':参数的优化算法,可选为{ 'lbfgs', 'sgd', 'adam'},分别对应{ 拟牛顿法,随机梯度下降,基于随机梯度下降的自适应}的具体实现算法

4)、alpha=0.:L2正则化参数

5)、batch_size='auto':对于随机优化器来说是可选的,批大小,设为auto时为min(,n_SAMPLES)

6)、learning_rate="constant":参数更新时的学习率,只在solver='sgd'时有效,可选为{ 'constant', 'invscaling', 'adaptive'},分别对应{ 常数即=初始学习率,逐渐降低,自适应}

7)、learning_rate_init=0.:初始学习率,只在solver='sgd' 或'adam'起作用

8)、power_t=0.5:影响learning_rate=" invscaling "时的学习率降低(有个计算公式effective_learning_rate = learning_rate_init / pow(t, power_t),t表示时间步)

9)、max_iter=:最大迭代轮数

)、tol=1e-4:损失值容忍阈值,小于该值时停止训练

2、MLPRegressor类,多层感知机回归

原理及公式:本来输出的就是连续值,用来做分类要加上softmax层,这里只是去掉该层

代码:略

结果图示:略

note:

1、参数同分类,无新参数需要说明

2、各属性值含义亦同。