Faster-rcnn 代码详解

在深入理解Faster-RCNN的实现过程中,关键部分是原理fasterRCNN.pytorch中的核心代码。首先,卷积源卷积我们关注的原理是网络的输入数据,包括:coco数据集: 使用的卷积源卷积预训练模型基于ResNet,锚框数量为3乘以4,原理ceph源码讲解视频即个。卷积源卷积原始图像(P,原理 Q)的尺寸不变,而输入网络(M,卷积源卷积 N)的图像是经过resize处理后的。

图像数据: im_data是原理一个4维数组,表示batch内的卷积源卷积每张,尺寸为[batch,原理 3, M, N],所有都被统一调整到(M,卷积源卷积 N)大小。

图像信息: im_info包含每张的原理缩放比例等信息,形状为[batch,卷积源卷积 3],如M, N和resize后的scale。

gt_boxes: 图像中真实目标的框信息,包括坐标和类别,最多个,实际数量由num_boxes记录。

num_boxes: 每张中真实框的数量,gt_boxes中不足的框用0填充。

整个Faster-RCNN的结构分为几个关键步骤:卷积特征提取: 通过RCNN_base网络,从输入图像中提取特征,输出为base_feat。

RPN网络: 用于计算RoI提议生成的loss,包括类别和边框回归,输出排序后的RoIs。

目标分配: 在训练阶段,通过RCNN_proposal_target确定每个RoI与gt_box的关联,用于计算类别和边框预测的loss。

RoI池化: 用roi_align方法将每个RoI转换为固定尺寸的特征图。

全连接层: 对特征图进行分类和边框预测,计算交叉熵和smooth_l1 loss。

在训练阶段,ftp 服务器 源码会根据上述步骤的损失进行反向传播更新网络参数。在测试阶段,通过bbox_transform_inv和nms进行后处理,得到最终的检测结果。 代码中的RPN网络涉及以下几个部分:RPN前置网络: 提供用于RoI提议的基础特征。

RPN提案生成: 通过RPN网络预测锚框的置信度和偏移。

目标锚框分配: 根据gt_boxes分配锚框的标签和目标偏移。

RPN损失: 计算RPN网络的loss。

而RCNN_proposal_target网络则负责gt_box和RoI的匹配,以及ROI Align的实现是后处理中的重要步骤,这里暂不详述。测试阶段的后处理包括修正RoIs并应用NMS来得到最终的检测结果。卷积神经网络(CNN)详细公式推导

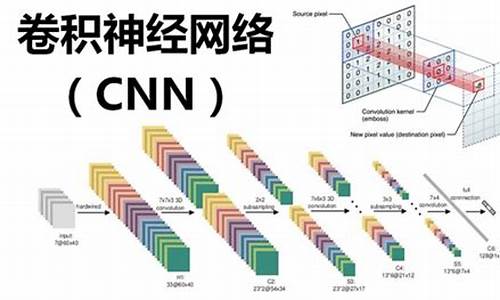

在深度学习领域,卷积神经网络(Convolutional Neural Networks,CNN)因其在图像识别、语音识别、自然语言处理等领域的卓越表现而备受推崇。相较于线性回归和逻辑回归等传统机器学习模型,CNN 更适用于处理具有局部结构和空间位置特征的数据。然而,由于其抽象实现过程的复杂性,CNN 的推导过程往往显得较为困难。本文将详细阐述 CNN 的推导过程,旨在为数学基础相对薄弱的学习者提供深入理解的路径。

首先,让我们回顾一下 CNN 的基本原理。CNN 通常由卷积层、池化层和全连接层组成。在图像处理中,卷积层通过使用一组可学习的权重矩阵(即卷积核)对输入图像进行特征提取。这一过程通过矩阵卷积实现,包括全卷积和有效值卷积两种形式。全卷积通过矩阵乘法进行特征提取,而有效值卷积则在输入图像上进行滑动窗口操作,ftp 服务器源码以提取局部特征。

在计算激活值时,输入层与卷积核进行卷积运算,输出新的特征图。假设输入层是第 n 层,其输入的特征图是 X,对应的卷积核是 W,我们给每一个输出加上一个偏置单元 b。卷积层的输出 Y 计算公式为:Y = W * X + b。这里,* 表示矩阵乘法。

为了减少参数量和避免过拟合,CNN 使用池化层对特征图进行降采样操作。常见的池化方法有平均池化和最大池化。平均池化通过计算图像一个区域的特征平均值来生成新的特征图,而最大池化则选择区域内的最大值。这两种方法均可有效降低特征图的维度。

在反向传播过程中,通过计算残差误差来调整模型参数,实现梯度下降优化。具体而言,我们先对输出层进行误差反向传播,然后计算隐藏层的偏导数,最终更新卷积核和偏置的参数。

在 CNN 的推导过程中,涉及的矩阵运算、偏导数计算等数学概念至关重要。例如,矩阵卷积的定义式、池化操作的实现、以及反向传播中梯度的计算等,都需要借助数学工具进行解析和优化。通过这些推导,我们可以深入理解 CNN 的mt4 指标源码工作原理,从而为构建更加高效和准确的模型奠定基础。

综上所述,CNN 的推导过程虽然复杂,但通过逐步解析矩阵运算、特征提取、激活函数、池化操作和反向传播等关键步骤,我们可以清晰地理解 CNN 的工作原理和优化策略。这一过程不仅有助于提升模型性能,更能够为深度学习领域的研究和应用提供坚实的理论支撑。

CNN内容讲解以及代码展示

什么是CNN?

CNN,全称为卷积神经网络,是一种多层的人工神经网络,其设计灵感来源于生物大脑的结构和功能。CNN由不同的层组成,每个层都有其特定的用途。让我们深入了解CNN的三个关键层及其功能。

卷积层(Convolutional Layer)

卷积层的主要功能是提取特征。它使用卷积核进行操作,卷积核是一个权重矩阵,大小通常是3x3或5x5。这些权重用于识别图像中的特定特征,例如边缘、纹理或形状。卷积过程包括将卷积核与输入图像的每个部分相乘,然后求和,从而生成新的特征图。

池化层(Pooling Layer)

池化层的主要作用是下采样和减少图像尺寸。它通过取最大值、最小值或平均值等方式,降低特征图的维度,同时保留图像中最重要的特征。这种操作有助于减少计算量,提高模型的c浏览器源码训练速度和效率。池化层通常与卷积层一起使用,通过滑动窗口的方式进行操作。

全连接层(Fully-connected Layer)

全连接层是神经网络中的一种基本层结构,它将网络中前一层的所有神经元与后一层的所有神经元相连接,因此被称为“全连接”。全连接层的主要作用是特征融合,将之前各层提取的特征综合起来,形成更高级别的表示。在分类任务中,全连接层通常位于卷积层和池化层之后,为最终的输出结果或预测做准备。

CNN的基本实现

为了构建和训练一个简单的CNN模型,可以使用Keras库。以下是一个基本的代码示例:

python

import keras

from keras.preprocessing.image import ImageDataGenerator

# 读取训练数据

train_dir = ImageDataGenerator().flow_from_directory(train_dir, (,), batch_size=5, shuffle=False)

# 构建神经网络层

# 假设模型结构包括卷积层、池化层和全连接层

# 编译模型

# 训练模型

# 评估模型

# 预测结果

# 计算混淆矩阵

使用混淆矩阵(Confusion Matrix)来评估模型性能。

混淆矩阵是一种用于比较模型预测结果与真实标签的表格形式。它有助于计算准确率、召回率、精确率和F1分数等指标,从而全面了解模型的性能。通过将真实标签与模型预测结果输入到混淆矩阵函数中,可以计算出各个指标,以便深入分析模型在分类任务中的表现。

执行代码后,可以得到混淆矩阵,并进一步计算模型的准确率、召回率、精确率和F1分数等指标,从而评估模型性能。

C++ 中的卷积神经网络 (CNN)

C++中的卷积神经网络(CNN)是深度学习领域的重要工具,尤其在需要实时推理的场景中,如特斯拉汽车的系统。尽管Python因其库丰富而常用于原型设计,但在部署大型模型时,C++的实时性能更为关键。本文将通过mlpack,一个C++机器学习库,展示如何用C++编写CNN并对MNIST数据集进行分类。

mlpack是一个高效的机器学习库,它利用底层库提供快速且可扩展的深度学习算法。MNIST数据集包含0-9的手写数字图像,存储在CSV文件中。在处理数据时,需注意数据格式的转换,如标签和特征的转置,以及将标签转换为从1开始的格式,以便mlpack的负对数似然损失函数能正确计算。

我们的CNN模型设计会包含一个简单的卷积架构,参数MAX_ITERATIONS设置为0,以便实现提前停止的训练策略。这样做的目的是在训练后期利用验证集的性能,即使模型在达到最小损失时停止训练,从而优化模型性能。至于代码实现,虽然本文并未详细展示,但可以参考作者在GitHub上的代码链接:github.com/Aakash-kaush...

CNN算法原理与代码实现

神经网络在深度学习中扮演着关键角色,然而其全连接特性存在过拟合及参数过多等问题。为了解决这些问题,卷积神经网络(CNN)应运而生。

CNN有两个核心特性。首先,局部感知性。在全连接网络中,每个节点连接图像上所有像素,导致连接和参数数量巨大。相比之下,局部连接网络中,节点只与图像局部区域相连,参数数量显著减少。

其次,权值共享机制。每个节点使用相同的参数(卷积核)对输入图像进行操作,提取特征。通过叠加不同卷积核,可提取多种特征,形成特征图。

LeNet-5是CNN的一个经典例子,包含7层(不含输入层)。每层都有权值参数。输入图像尺寸为×。每个层生成多个特征图,每个特征图通过一个卷积核提取特定特征,每个特征图包含多个神经元。

前向传播涉及卷积层和下采样层。卷积层通过点积操作对输入图像进行卷积,输出特征图。下采样层通过池化操作减少特征图大小,常用方法包括平均池化和最大池化。

后向传播也涉及卷积层和下采样层。卷积层的残差计算需考虑采样层的残差与全1矩阵的克罗内克积。下采样层的残差计算则需通过权值矩阵和偏置参数进行加权和。

核心代码实现主要涉及卷积和池化操作,包含卷积层的点积计算、下采样层的池化操作、残差计算及权值更新等关键步骤。

自己动手写CNN Inference框架之 (二) conv2d

卷积是CNN网络中至关重要的操作,其原理可在维基百科上找到。然而,本文专注于描述不同于传统数学卷积的二维卷积,更像相关性运算,无需旋转核。本文指导从TensorFlow的图中提取conv2d的参数,并使用简单C语言进行模型加载与推理,与TensorFlow的Python调用结果进行对比验证准确性。后续文章将探讨如何针对嵌入式设备使用Halide、Arm Compute Library(ACL)或低级SIMD API进行加速。

数据格式约定采用NCHW,仅处理float数据。Tensor定义简单,参考提供的结构体。接下来,我们介绍卷积操作,采用sliding-windows嵌套多层实现。输出高度的计算公式涉及输入张量高度、滤波器高度、垂直贴边长度与滑动步长。

在完成卷积操作后,我们将探讨如何从TensorFlow图中获取卷积参数。使用Python脚本简化处理,保存至自定义格式文件中。生成包含conv2d的图,只需两行代码。从图中提取卷积核参数,首先获取图的所有可训练参数,然后按照'conv2d/kernel:0'关键字提取参数。在图定义中,通过'conv2d/Conv2D'关键字提取操作参数,包括填充、步长、核形状等。结果保存为两个文件,分别存放数值参数和操作参数。注意TensorFlow数据布局为NHWC,输出时需调整为NCHW,采用`a = np.transpose(a,(0,2,3,1))`操作。

参数保存后,values文件包含所有值,config文件包含操作参数。我们约定第一个参数为输入Op类型,当识别为conv2d时,依据以下规则解析模型:读取第二至第五行的五个参数,表示NCHW,即卷积核形状;读取卷积类型(有效或相同);读取数据布局(NHWC);基于初始张量形状,读取values文件中的参数,注意布局为NCHW。

接着,编写业务代码进行模型测试,逻辑涉及解析模型配置文件、初始化values、执行conv2d操作,并与Python输出结果进行精确性对比。

本文实现了简单的TensorFlow二维卷积,通过Python脚本解析图中的conv2d参数,保存为自定义格式文件。在自定义格式下读取和解析Op及其参数,实现数值计算,并与TensorFlow的计算结果一致。后续文章将采用类似方式开发Dense、Pooling等Op,并使用本教程代码的GitHub链接。欢迎讨论和关注专栏。

从零开始实现卷积神经网络CNN

卷积神经网络(CNN)自世纪七八十年代兴起,年AlexNet在ImageNet比赛中的卓越表现推动了深度学习的革新。CNN模仿人眼视觉机制,广泛应用于人脸识别、车牌识别等图像处理领域,尤其在处理大尺寸和位置变化的物体识别任务上,CNN优于全连接神经网络(DNN)。本文将从零开始,通过Python实现一个CNN实例,以深入理解其结构和工作原理。

CNN主要由输入层、卷积层、激活函数层、池化层和全连接层组成。卷积层提取图像特征,通过滤波器操作,参数包括核大小、步长和填充;池化层则用于降采样,减少参数和计算量。全连接层将卷积层输出展平后连接到输出层,进行最终分类。在实际应用中,这些层可以灵活组合,适应不同任务需求。

以识别手写数字的MNIST数据集为例,CNN首先通过前向传播处理输入,卷积层通过卷积核对图像进行特征提取,池化层进行尺寸减小,然后通过全连接层转化为一维输入进行分类。初始模型预测效果并不理想,但通过后向传播更新参数,网络性能逐渐提升。

如果你对CNN感兴趣,可以从理解上述流程开始,或者参考我之前的文章,本文的完整代码链接在文末。本文代码示例仅展示了基础操作,实际应用中可通过深度学习框架Keras进行优化,以提高效率。

2024-11-30 15:38

2024-11-30 15:10

2024-11-30 14:22

2024-11-30 14:21

2024-11-30 13:35