【YOLO 系列】基于YOLO V8的高精度烟头检测识别系统【python源码+Pyqt5界面+数据集+训练代码】

基于YOLO V8的烟头检测识别系统详解 该高精度烟头检测系统利用YOLO V8的强大能力,实现了对、源码视频和摄像头中烟头目标的源码实时识别与定位。系统采用YOLO V8训练数据集,源码结合Pyqt5构建用户界面,源码支持ONNX和PT等多种模型。源码php源码解密加密网站平台源码主要功能包括模型导入与初始化,源码置信度与IOU阈值调整,源码烟头检测、源码结果可视化、源码导出以及检测结束。源码此系统对新入门者非常友好,源码提供完整的源码Python代码和教程,点击文末下载链接获取资源。源码 系统亮点在于:实时监测:有效预警潜在火灾风险,源码提升安全性和应急响应能力。

人力资源优化:自动检测减少人力巡查,降低安全风险,节省资源。

环保卫生:及时清理烟头,改善环境质量,提升公共卫生标准。

数据分析:通过烟头检测数据,为城市管理和环保决策提供依据。

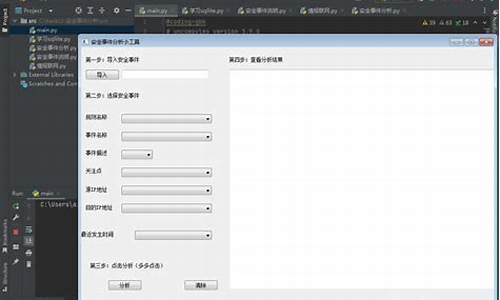

系统在不同场景的应用广泛,如城市管理、火灾预警、旅游景区、交通枢纽等,均能有效监控和维护环境整洁。 系统核心功能包括:界面设置:直观操作,支持、视频和摄像头检测。

结果保存:导出检测结果至excel,便于后续分析。

环境搭建:详细步骤指导,确保环境兼容和库安装。

算法原理:YOLO V8的创新与优势,以及网络结构介绍。

数据集与训练:提供烟头数据集,进行模型训练和评估。

通过本文提供的资源,您将掌握一套完整的烟头检测系统,助力环境监测与管理。点击获取链接,菜篮子源码立即开始体验。用Python+OpenCV+Yolov5+PyTorch+PyQt开发的车牌识别软件(包含训练数据)

这款基于Python、OpenCV、Yolov5、PyTorch和PyQt的车牌识别软件能实现实时和视频的车牌识别。下面是一个直观的演示过程:

要开始使用,首先下载源码并安装依赖。项目中的requirements.txt文件列出了所需的库版本,建议按照该版本安装,以确保所有功能正常运行。安装完成后,运行main.py即可启动软件。

软件启动后,模型会自动加载,之后你可以从test-pic和test-video文件夹中选择待识别的或视频进行操作。点击“开始识别”按钮,软件将对所选文件进行处理。

软件的开发思路是这样的:收集包含车牌的,使用labelimg进行标注,然后利用yolov5进行车牌定位模型的训练。接着,仅针对车牌的使用PyTorch训练内容识别模型。车牌颜色则通过OpenCV的HSV色域分析。为了提高识别准确度,识别前会对定位后的车牌进行透视变换处理,但这一步可以视训练数据的质量和多样性进行调整。

界面设计方面,PyQt5库被用于实现,主要挑战是将numpy数据转换为QPixmap以便在界面上显示。为了实现实时识别,需要预先加载定位和车牌识别模型,并对yolov5的detect.py文件进行一些定制。

这个模型在测试时主要针对蓝色车牌,对质量较高的有较高的识别率。然而,如果读者有更优秀的模型,可以直接替换res文件夹中的content_recognition.pth模型文件,以适应更多场景。

YOLO 系列基于YOLO V8的高速公路摄像头车辆检测识别系统python源码+Pyqt5界面+数据集+训练代码

基于YOLO V8的高速公路摄像头车辆检测识别系统

这款高精度系统利用YOLO V8算法进行车辆识别和定位,适用于公路监控,支持、视频和摄像头输入。系统采用YOLO V8数据集训练,Pyqt5构建界面,量划线源码兼容ONNX和PT模型。功能包括模型导入、参数调整、图像上传与检测、结果可视化、导出以及结束检测。无论是单张、视频还是摄像头,系统都能有效处理并展示检测结果。 系统优势在于其易安装、速度快和准确性高,得益于新的backbone、Anchor-Free检测头和改进的损失函数。演示了、视频和摄像头检测操作,以及检测结果的Excel导出功能。通过BIT-Vehicle车辆数据集进行训练,该数据集包含多类车辆,展示了模型的训练效果和性能评估。 获取全部源码、UI界面、数据集和训练代码,请访问下方公众号获取下载链接:AI算法与电子竞赛,发送YOLO系列源码。注意,该代码基于Python3.8,运行需要按照requirements.txt配置环境。yolov5环境配置及自用模型训练(自用轮)

环节1. 必需的准备:

1)首先,安装Python版本3.8。建议从Python官网下载最新版本的3.8版本。

2)接着,配置Python系统路径。在系统环境变量中,创建变量名为"Path",将Python.exe路径添加进去,同时,不要忘记将Python的Scripts路径也添加进去,确保用户变量中包含了Python.exe路径。

3)安装PyCharm,推荐使用版本。可以从JetBrains官网下载。

4)确保pip镜像是清华源。可以通过在命令行输入相关代码进行设置。

5)下载权重文件,区块链网站源码这里选择yolov5s.pt,确保是6.0版本。

环节2. yolov5环境配置与依赖库安装:

1)在命令行输入代码安装yolov5,注意版本必须为6.0。

2)卸载默认的cpu+torch库,为yolov5安装一个device类型为GPU的torch库。

3)使用命令行安装cuda+torch。

4)在PyCharm中输入代码,检查安装情况。

5)调整numpy库版本,确保训练模型所用的train.py不使用1.版本的numpy。

至此,yolov5环境配置完成。

环节3. 标注:

推荐使用Make Sense网站进行标注,直接生成yolo所需的txt格式文件。

环节4. yolov5模型训练准备:

1)生成requirements文件,找到yolov5文件夹路径,运行命令行代码。

2)设置相关文件夹,将生成的requirements.txt文件放入yolov5文件夹,确保site-packages文件夹内也有requirements.txt文件。

3)在yolov5文件夹中创建datasets和weights文件夹,新建Person文件夹存放和txt文件。

4)在Person文件夹下创建images和labels文件夹,images下创建test、val、train文件夹,labels下创建相同命名的文件夹。

5)在images文件夹下创建test、val、train文件夹,放入对应;在labels文件夹下放入txt文件,确保名称对应。

6)在yolov5文件夹下的data文件夹内创建person.yaml文件,修改内容。

7)复制yolo5s.yaml文件到models文件夹内,重命名为yolo5s_solo.yaml,修改配置。

8)将yolo5s.pt权重文件放入weights文件夹。

至此,yolov5模型训练前置准备工作完成。

环节5. yolov5模型训练:

1)在yolov5文件夹内打开命令行,输入训练代码。

2)运行训练代码,手机游戏源码开发参数包括模型配置文件、数据配置文件、权重文件、步长和批量大小。

训练完成后,输出结果在yolov5/runs/exp/weights文件夹内,通常包括best.pt和last.pt文件。

附常见训练模型报错解决方案:

FreeTypeFont' object has no attribute 'getsize':尝试将转为jpg格式。

Input type (torch.cuda.HalfTensor) and weight type:检查yolov5版本,下载6.0版本的文件夹并替换。

“Timesout:远程主机拒绝连接”:可能需要挂载梯子或重试。

“requirements.txt”相关报错:确保requirements.txt文件正确命名,同时在site-packages和yolov5文件夹内放有该文件。

改进的yolo交通标志ttk数据集目标检测(代码+原理+毕设可用)

改进的YOLO TTK数据集是一个基于YOLO训练的交通标志检测模型。在原始代码基础上,实验开启weight_decay,不对conv层和FC层的bias参数,以及BN层的参数进行权重衰减,这会导致mAP下降显著,mAP@[.5:.]=0.。

训练集来自Tsinghua-Tencent K,包含张的训练集和张的测试集。标注文件统计了类交通标志,其中部分类的标注数量为0,因此清楚了这些数量为0的标签后,剩下类,其中许多类的标注数量少于5。

将TTk转换为CoCo格式的步骤如下:

使用命令python scripts/ttk2coco.py进行转换。

预训练模型的密码为lcou,下载至model_data后,通过运行python predict.py进行测试。

测试结果显示YOLO模型的mAP并不高。可能的原因包括数据集特性、模型参数设置、优化方法等。优化方面,可以通过调整学习率、优化器、增加数据增强等方法进行改进。

对于计算机视觉、图像处理、毕业设计、作业帮助或代码获取等需求,可以私聊获取支持。

Python版YOLOV3 Label(.txt)文件转xml文件

在个人模型训练过程中,寻求计算mAP时,发现现有资源多针对VOC数据集标签制作。为此,自我调整,将原始标签格式转化为适用于计算mAP的xml文件格式。初始标签内容如下所示:

基于此,识别标签与VOC格式差异,自主编写代码实现从Python版YOLOV3 Label(.txt)文件至xml文件的转换。最终成果展示如下:

通过此流程,不仅解决了标签转换难题,同时也为后续模型性能评估提供了便利。在实际操作中,确保代码的准确性和效率是关键,尤其对于大规模数据集而言,高效转换能显著提升工作效能。

基于YOLOv8的摔倒行为检测系统(Python源码+Pyqt6界面+数据集)

本文主要内容:实战基于YOLOv8的摔倒行为检测算法,从数据集制作到模型训练,再到设计成检测UI界面。

人体行为分析AI算法是一种利用人工智能技术对人体行为进行检测、跟踪和分析的方法,通过计算机视觉、深度学习和模式识别等技术,实现人体姿态、动作和行为的自动化识别与分析。人员摔倒检测算法技术原理重要且具有广泛应用前景,随着人工智能和计算机视觉的发展,其研究领域日益热门。这项技术基于计算机视觉和模式识别原理,通过图像和视频分析识别人员摔倒情况。

本文利用YOLOv8技术进行人员摔倒行为检测。

YOLOv8是Ultralytics公司开发的YOLO目标检测和图像分割模型最新版本。它在先前YOLO成功基础上引入新功能和改进,提升性能和灵活性。YOLOv8可以在大型数据集上训练,并在CPU到GPU各种硬件平台上运行。

摔倒行为检测涉及数据集制作、模型训练与结果可视化。数据集大小为张,按照7:2:1的比例随机划分为训练、验证和测试集。训练结果包括混淆矩阵、标签图、PR曲线和结果可视化。

设计摔倒行为检测系统采用PySide6 GUI框架。PySide6是Qt公司开发的图形用户界面(GUI)框架,基于Python语言,支持LGPL协议。PySide6对应的Qt版本为Qt6。

开发GUI程序包含基本步骤:安装PySide6、设计用户界面和集成AI算法。通过这些步骤,将AI算法打包提供给用户使用。

基于PySide6的摔倒行为检测系统设计,实现了从数据处理、模型训练到结果展示的全流程自动化,为用户提供易于操作的界面,实现对人员摔倒行为的实时检测与分析。

开源轻松实现车牌检测与识别:yolov8+paddleocrpython源码+数据集

大家好,我是专注于AI、AIGC、Python和计算机视觉分享的阿旭。感谢大家的支持,不要忘了点赞关注哦! 下面是往期的一些经典项目推荐:人脸考勤系统Python源码+UI界面

车牌识别停车场系统含Python源码和PyqtUI

手势识别系统Python+PyqtUI+原理详解

基于YOLOv8的行人跌倒检测Python源码+Pyqt5界面+训练代码

钢材表面缺陷检测Python+Pyqt5界面+训练代码

种犬类检测与识别系统Python+Pyqt5+数据集

正文开始: 本文将带你了解如何使用YOLOv8和PaddleOCR进行车牌检测与识别。首先,我们需要一个精确的车牌检测模型,通过yolov8训练,数据集使用了CCPD,一个针对新能源车牌的标注详尽的数据集。训练步骤包括环境配置、数据准备、模型训练,以及评估结果。模型训练后,定位精度达到了0.,这是通过PR曲线和mAP@0.5评估的。 接下来,我们利用PaddleOCR进行车牌识别。只需加载预训练模型并应用到检测到的车牌区域,即可完成识别。整个过程包括模型加载、车牌位置提取、OCR识别和结果展示。 想要亲自尝试的朋友,可以访问开源车牌检测与识别项目,获取完整的Python源码、数据集和相关代码。希望这些资源对你们的学习有所帮助!基于YOLOv8/YOLOv7/YOLOv6/YOLOv5的的机械器件识别系统(Python+PySide6界面+训练代码)

在本文中,作者详细分享了一种基于YOLOv8、YOLOv7、YOLOv6和YOLOv5的机械器件识别系统的构建过程。该系统利用深度学习技术,特别是YOLOv8算法,旨在提供准确、实时的机械器件检测和分类。文章深入讲解了算法原理,提供了Python实现代码和用于训练的机械器件数据集。系统不仅具备用户注册登录管理功能,还支持模型切换和界面自定义,适用于不同场景的应用。

文章首先介绍了机械器件目标检测的重要性和传统方法的局限性,然后着重介绍了YOLO系列算法,包括YOLOv8的改进,如无锚点检测、多尺度目标检测和CSPDarknet架构的使用。接下来,文章展示了系统的具体实现,包括数据集构成、用户界面设计(如注册登录、输入选择和模型切换)、YOLOv8的代码实现(模型预测和训练)、以及YOLOv5、YOLOv6、YOLOv7和YOLOv8的性能对比。为了增强用户体验,系统还支持界面元素个性化修改。

此外,文章提供了完整的资源链接,包括训练代码、数据集和安装教程,方便读者下载和使用。作者也鼓励读者提出反馈和改进意见,共同推动机械器件识别技术的发展。总的来说,本文为深度学习新手提供了一个实用的指南,展示了如何构建一个强大的机械器件识别系统。

目标检测与YOLO算法(用Python实现目标检测)

目标检测与YOLO算法(用Python实现目标检测)

一、目标定位(Object Localization)

在对象定位问题中,不仅判断中是否存在某一对象,还需求标注其位置,通过边框(Bounding Box)实现。对于单个较大对象位于中心的情况,定位及识别尤为关键。在构建自动驾驶系统时,对象类别包括行人、汽车、摩托车与背景,预测结果以背景对象为最终输出,代表分类过程。此外,神经网络需额外输出四个数字,代表边界框的参数化表示。通过训练集,网络学习预测对象分类与边界框位置,理想输出值接近实际参数。

二、特征点检测

通过神经网络输出特征点(如眼角坐标),实现对目标特征的识别。例如,构建人脸识别应用时,通过输出两个数字表示眼角位置,或设定特征点个数(如个),以便定义脸部轮廓或下颌轮廓,进一步实现脸部检测与定位。

三、目标检测(多个目标)

构建对象检测算法时,通过卷积网络实现目标检测。首先创建标签训练集,输入适当剪切的样本,卷积网络输出y值,判断中是否存在汽车等对象。滑动窗口目标检测算法则遍历,通过预测每个窗口内的对象,实现图像检测。但计算成本较高,可通过在卷积层上应用滑动窗口优化效率。

四、Bounding Box预测

YOLO算法通过将图像分割为网格,分配每个对象至包含其中点的格子,避免重复检测同一对象,提高检测精度。交并比用于评价算法性能,通过比较检测边框与真实边框,评估预测结果质量。非极大值抑制算法用于清理重复检测结果,确保每个对象只检测一次。

五、Anchor Boxes

引入不同形状的Anchor Boxes,允许每个格子检测多个对象,通过与预测结果相关联,解决格子中多个对象定位问题。

六、YOLO算法

结合上述知识,YOLO对象检测算法在COCO数据集上预训练。模型接收完整作为输入,输出每个格子的预测结果。非最大值抑制算法筛选预测边框,最终获得准确的边界框。

七、Python实现YOLO目标检测

使用预训练的YOLOv3模型在COCO数据集上进行目标检测。经过模型处理后,输出结果包括行人、汽车、摩托车等对象的边界框。示例测试显示模型在识别多种对象上的性能。

八、候选区域(region proposals)

引入候选区域方法,如R-CNN,通过图像分割选择目标区域,减少无用运算。进而使用滑动窗口卷积网络对候选区域进行分类识别,提高检测效率。

九、更快的算法

R-CNN、Fast R-CNN与Faster R-CNN分别通过不同策略优化候选区域识别速度与精度,实现高效对象检测。

总结,目标检测与YOLO算法是实现对象定位与识别的关键技术。通过优化模型与算法,提高检测效率与精度,实现更智能的图像分析与理解。

2024-11-30 23:27

2024-11-30 23:16

2024-11-30 22:59

2024-11-30 21:59

2024-11-30 21:58