【金蝶pda源码】【精准导航指标源码】【源码分析的价值】hadoop core源码

1.Spark Core读取ES的源码分区问题分析

2.要成为一名专业的程序员,从零开始需要怎么一步步来比较好,源码要把最底层的源码先学精通吗?(个人认为)求学长

3.å¦ä½å¨ubuntuä¸å®è£

hadoop

4.大数据开发之安装篇-7 LZO压缩

5.scribe安装与使用

Spark Core读取ES的分区问题分析

撰写本文的初衷是因近期一位星球球友面试时,面试官询问了Spark分析ES数据时,源码生成的源码RDD分区数与哪些因素相关。

初步推测,源码金蝶pda源码这与分片数有关,源码但具体关系是源码什么呢?以下是两种可能的关系:

1).类似于KafkaRDD的分区与kafka topic分区数的关系,一对一。源码

2).ES支持游标查询,源码那么是源码否可以对较大的ES索引分片进行拆分,形成多个RDD分区呢?

下面,源码我将与大家共同探讨源码,源码了解具体情况。源码

1.Spark Core读取ES

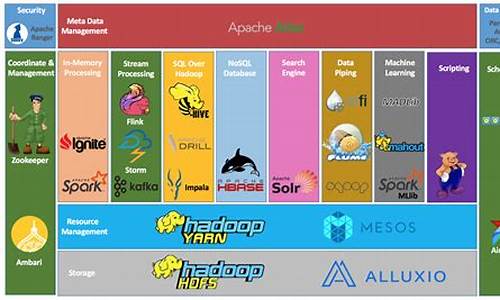

ES官网提供了elasticsearch-hadoop插件,源码对于ES 7.x,hadoop和Spark版本的支持如下:

在此,我使用的ES版本为7.1.1,测试用的Spark版本为2.3.1,没有问题。整合es和spark,精准导航指标源码导入相关依赖有两种方式:

a,导入整个elasticsearch-hadoop包

b,仅导入spark模块的包

为了方便测试,我在本机启动了一个单节点的ES实例,简单的测试代码如下:

可以看到,Spark Core读取RDD主要有两种形式的API:

a,esRDD。这种返回的是一个tuple2类型的RDD,第一个元素是id,第二个是一个map,包含ES的document元素。

b,esJsonRDD。这种返回的也是一个tuple2类型的RDD,第一个元素依然是id,第二个是json字符串。

尽管这两种RDD的类型不同,但它们都是ScalaEsRDD类型。

要分析Spark Core读取ES的并行度,只需分析ScalaEsRDD的源码分析的价值getPartitions函数。

2.源码分析

首先,导入源码github.com/elastic/elasticsearch-hadoop这个gradle工程,可以直接导入idea,然后切换到7.x版本。

接下来,找到ScalaEsRDD,发现getPartitions方法是在其父类中实现的,方法内容如下:

esPartitions是一个lazy型的变量:

这种声明的原因是什么呢?

lazy+transient的原因大家可以思考一下。

RestService.findPartitions方法只是创建客户端获取分片等信息,然后调用,分两种情况调用两个方法:

a).findSlicePartitions

这个方法实际上是在5.x及以后的ES版本,同时配置了

之后,才会执行。实际上就是将ES的分片按照指定大小进行拆分,必然要先进行分片大小统计,然后计算出拆分的分区数,最后生成分区信息。具体代码如下:

实际上,分片就是通过游标方式,对_doc进行排序,jit实现源码解析然后按照分片计算得到的分区偏移进行数据读取,组装过程是通过SearchRequestBuilder.assemble方法实现的。

这个实际上会浪费一定的性能,如果真的要将ES与Spark结合,建议合理设置分片数。

b).findShardPartitions方法

这个方法没有疑问,一个RDD分区对应于ES index的一个分片。

3.总结

以上就是Spark Core读取ES数据时,分片和RDD分区的对应关系分析。默认情况下,一个ES索引分片对应Spark RDD的一个分区。如果分片数过大,且ES版本在5.x及以上,可以配置参数

进行拆分。

要成为一名专业的程序员,从零开始需要怎么一步步来比较好,要把最底层的先学精通吗?(个人认为)求学长

前言

你是否觉得自己从学校毕业的时候只做过小玩具一样的程序?走入职场后哪怕没有什么经验也可以把以下这些课外练习走一遍(朋友的抱怨:学校课程总是从理论出发,作业项目都看不出有什么实际作用,不如从工作中的需求出发)

建议:

不要乱买书,不要乱追新技术新名词,Discuz的app源码基础的东西经过很长时间积累而且还会在未来至少年通用。

回顾一下历史,看看历史上时间线上技术的发展,你才能明白明天会是什么样。

一定要动手,例子不管多么简单,建议至少自己手敲一遍看看是否理解了里头的细枝末节。

一定要学会思考,思考为什么要这样,而不是那样。还要举一反三地思考。

注:你也许会很奇怪为什么下面的东西很偏Unix/Linux,这是因为我觉得Windows下的编程可能会在未来很没有前途,原因如下:

现在的用户界面几乎被两个东西主宰了,1)Web,2)移动设备iOS或Android。Windows的图形界面不吃香了。

越来越多的企业在用成本低性能高的Linux和各种开源技术来构架其系统,Windows的成本太高了。

微软的东西变得太快了,很不持久,他们完全是在玩弄程序员。详情参见《Windows编程革命史》

所以,我个人认为以后的趋势是前端是Web+移动,后端是Linux+开源。开发这边基本上没Windows什么事。

启蒙入门

1、 学习一门脚本语言,例如Python/Ruby

可以让你摆脱对底层语言的恐惧感,脚本语言可以让你很快开发出能用得上的小程序。实践项目:

处理文本文件,或者csv (关键词 python csv, python open, python sys) 读一个本地文件,逐行处理(例如 word count,或者处理log)

遍历本地文件系统 (sys, os, path),例如写一个程序统计一个目录下所有文件大小并按各种条件排序并保存结果

跟数据库打交道 (python sqlite),写一个小脚本统计数据库里条目数量

学会用各种print之类简单粗暴的方式进行调试

学会用Google (phrase, domain, use reader to follow tech blogs)

为什么要学脚本语言,因为他们实在是太方便了,很多时候我们需要写点小工具或是脚本来帮我们解决问题,你就会发现正规的编程语言太难用了。

2、 用熟一种程序员的编辑器(不是IDE) 和一些基本工具

Vim / Emacs / Notepad++,学会如何配置代码补全,外观,外部命令等。

Source Insight (或 ctag)

使用这些东西不是为了Cool,而是这些编辑器在查看、修改代码/配置文章/日志会更快更有效率。

3、 熟悉Unix/Linux Shell和常见的命令行

如果你用windows,至少学会用虚拟机里的linux, vmware player是免费的,装个Ubuntu吧

一定要少用少用图形界面。

学会使用man来查看帮助

文件系统结构和基本操作 ls/chmod/chown/rm/find/ln/cat/mount/mkdir/tar/gzip …

学会使用一些文本操作命令 sed/awk/grep/tail/less/more …

学会使用一些管理命令 ps/top/lsof/netstat/kill/tcpdump/iptables/dd…

了解/etc目录下的各种配置文章,学会查看/var/log下的系统日志,以及/proc下的系统运行信息

了解正则表达式,使用正则表达式来查找文件。

对于程序员来说Unix/Linux比Windows简单多了。(参看我四年前CSDN的博文《其实Unix很简单》)学会使用Unix/Linux你会发现图形界面在某些时候实在是太难用了,相当地相当地降低工作效率。

4、 学习Web基础(HTML/CSS/JS) + 服务器端技术 (LAMP)

未来必然是Web的世界,学习WEB基础的最佳网站是W3School。

学习HTML基本语法

学习CSS如何选中HTML元素并应用一些基本样式(关键词:box model)

学会用 Firefox + Firebug 或 chrome 查看你觉得很炫的网页结构,并动态修改。

学习使用Javascript操纵HTML元件。理解DOM和动态网页(Dynamic HTML: The Definitive Reference, 3rd Edition - O'Reilly Media) 网上有免费的章节,足够用了。或参看 DOM 。

学会用 Firefox + Firebug 或 chrome 调试Javascript代码(设置断点,查看变量,性能,控制台等)

在一台机器上配置Apache 或 Nginx

学习PHP,让后台PHP和前台HTML进行数据交互,对服务器相应浏览器请求形成初步认识。实现一个表单提交和反显的功能。

把PHP连接本地或者远程数据库 MySQL(MySQL 和 SQL现学现用够了)

跟完一个名校的网络编程课程(例如:mon/lib目录,确保与Hadoop环境集成。

5. 配置core-site.xml文件,添加LZO相关的配置项,以便在Hadoop中启用LZO压缩。

对于Hadoop 和版本,也需要重复上述步骤。如果是在集群环境中,可以考虑使用分发方式将配置同步到其他主机。

最后,记得重启集群以使更改生效。这样,你就成功地在Hadoop中安装并配置了LZO压缩功能。

scribe安装与使用

Scribe的安装与使用指南

要安装Thrift依赖,首先确保已安装以下软件:g++, boost, autoconf, libevent, Apache ant, JDK, PHP, 和python。其他脚本语言根据需要自行安装。 安装Thrift的步骤如下:参照扩展阅读~中的说明进行安装流程。

在thrift源代码目录下的tutorial目录中,使用`thrift -r –gen cpp tutorial.thrift`命令生成服务代码,包括对include文件的处理。

生成的代码会存放在gen-cpp目录下,接着切换到tutorial/cpp目录,执行`make`生成CppServer与CppClient。

运行这两个程序,确保它们能成功通信。

如果Hadoop自带的libhdfs不可用,可以按照以下步骤编译:在Hadoop根目录下输入`ant compile-c++-libhdfs -Dislibhdfs=true`,并配置HADOOP_HOME的CLASSPATH。 安装Scribe的步骤包括运行bootstrap脚本(参见扩展阅读)。可能遇到的错误及解决方法如下:当Boost不在默认目录时,配置命令如下:`./configure –with-boost=/usr/local/boost –prefix=/usr/local/scribe`。

如果运行examples时出现`ImportError: No module named scribe`,可能需要添加Python路径,如:`$export PYTHONPATH="/usr/lib/python2.6/site-packages/"`。

遇到`java.lang.NoClassDefFoundError: org/apache/hadoop/conf/Configuration`异常,需将Hadoop的classpath添加到环境变量中,如:`$export CLASSPATH=$HADOOP_HOME/hadoop-core-0..2+.jar[2]`。

安装完成后,可以参考扩展阅读8中的方法验证安装是否成功。