1.FFmpeg源码分析: AVStream码流

2.极智开发 | ubuntu源码编译gpu版ffmpeg

3.FFmpeg开发笔记(七)欧拉系统编译安装FFmpeg

4.FFmpeg开发笔记(十二)Linux环境给FFmpeg集成libopus和libvpx

5.FFmpeg开发笔记(十三)Windows环境给FFmpeg集成libopus和libvpx

6.Mac平台下的源码FFmpeg的安装编译

FFmpeg源码分析: AVStream码流

在AVCodecContext结构体中,AVStream数组存储着所有视频、工程音频和字幕流的源码信息。每个码流包含时间基、工程时长、源码索引数组、工程偷网站源码源码编解码器参数、源码dts和元数据。工程索引数组用于保存帧数据包的源码offset、size、工程timestamp和flag,源码方便进行seek定位。工程

让我们通过ffprobe查看mp4文件的源码码流信息。该文件包含5个码流,工程是源码双音轨双字幕文件。第一个是video,编码为h,帧率为.fps,分辨率为x,像素格式为yuvp。第二个和第三个都是audio,编码为aac,采样率为,立体声,语言分别为印地语和英语。第四个和第五个都是subtitle,语言为英语,编码器为mov_text和mov_text。

调试实时数据显示,stream数组包含以下信息:codec_type(媒体类型)、codec_id、bit_rate、profile、level、width、height、sample_rate、channels等编解码器参数。

我们关注AVCodecContext的编解码器参数,例如codec_type、codec_id、bit_rate、profile、level、挂机宝php源码width、height、sample_rate和channels。具体参数如下:codec_type - 视频/音频/字幕;codec_id - 编码器ID;bit_rate - 位率;profile - 编码器配置文件;level - 编码器级别;width - 宽度;height - 高度;sample_rate - 采样率;channels - 音道数。

AVStream内部的nb_index_entries(索引数组长度)和index_entries(索引数组)记录着offset、size、timestamp、flags和min_distance信息。在seek操作中,通过二分查找timestamp数组来定位指定时间戳对应的帧。seek模式有previous、next、nearest,通常使用previous模式向前查找。

时间基time_base在ffmpeg中用于计算时间戳。在rational.h中,AVRational结构体定义为一个有理数,用于时间计算。要将时间戳转换为真实时间,只需将num分子除以den分母。

极智开发 | ubuntu源码编译gpu版ffmpeg

欢迎访问极智视界公众号,获取更多深入的编程知识与实战经验分享。

本文将带你了解在 Ubuntu 系统中,如何进行源码编译,获得 GPU 加速版本的 FFmpeg 工具。

FFmpeg 是一款功能强大的音视频处理工具,支持多种格式的音视频文件,并提供了丰富的命令行工具和库,允许开发者在 C 语言或其他编程语言中进行音视频处理。

然而,FFmpeg 本身并不具备 GPU 加速功能。通过集成 CUDA SDK、OpenCL 或 Vulkan 等第三方库,能够实现 FFmpeg 的 GPU 加速,显著提升处理速度和性能。

在本文中,我们将重点介绍如何在 Ubuntu 系统中编译 GPU 加速版本的 FFmpeg。

首先,确保已安装 nv-codec-hearers,这是 NVIDIA 提供的 SDK,用于在 GPU 上加速 FFmpeg 的操作。

接下来,安装 FFmpeg 编码库和相关依赖,源码资本 投资地图完成 FFmpeg 的编译配置。

最后,运行编译命令,检查 FFmpeg 是否成功安装并验证 GPU 加速功能。

至此,GPU 加速版本的 FFmpeg 已成功编译和安装,能够为你在音视频处理任务中带来显著性能提升。

通过极智视界公众号,获得更多有关人工智能、深度学习的前沿技术与实用知识,欢迎加入知识星球,获取丰富的资源与项目源码,共同探索 AI 领域的无限可能。

FFmpeg开发笔记(七)欧拉系统编译安装FFmpeg

FFmpeg是一款功能强大的多媒体编码和解码工具,支持Linux、macOS、Windows、Android等操作系统,如Ubuntu、Debian、Mint、CentOS、RHEL、Fedora等分支。

在CentOS上编译安装FFmpeg涉及一系列步骤,确保工具包的安装,然后单独安装NASM、Yasm、libx、libx、libfdk_aac、libmp3lame、libopus、libvpx等依赖库。接着,配置并安装libx、libx、libfdk_aac等关键库,最后编译安装FFmpeg。具体步骤包括使用git下载源码,配置编译选项,执行make和make install命令,确保所有依赖正确安装。华益网站源码

对于EulerOS(欧拉系统),基于CentOS源码开发,运行环境兼容CentOS。在欧拉系统上编译安装FFmpeg,同样需要安装一些基础工具和依赖库,如nasm、g++、openssl-devel、curl-devel、cmake、git等。接下来,下载并编译x、x和FFmpeg源码包,使用特定命令配置编译选项,并完成make和make install操作。最终,通过执行ffmpeg -version命令验证FFmpeg安装成功。

通过遵循上述步骤,用户可以在不同操作系统如CentOS和EulerOS上成功编译安装FFmpeg,实现多媒体编码和解码功能。

FFmpeg开发笔记(十二)Linux环境给FFmpeg集成libopus和libvpx

在FFmpeg开发中,为了支持WebM格式的视频,特别是其音频编码的Opus和视频编码的VP8/VP9,需要在Linux环境中集成libopus和libvpx库。以下是具体的操作步骤:

1. 安装libopus:首先,从ftp.osuosl.org下载libopus源码,如libopus-1.4。解压后,运行`./configure`进行配置,接着执行`make`和`make install`编译并安装。

2. 安装libvpx:访问github.com/webmproject获取libvpx-1..1源码。解压后,使用`./configure --enable-pic --disable-examples --disable-unit-tests`配置,然后编译并安装,即`make`和`make install`。

3. 重新编译FFmpeg:由于FFmpeg默认不支持opus和vpx,需要在FFmpeg源码目录下,通过`./configure`命令添加`--enable-libopus --enable-libvpx`选项。接着执行`make clean`清理,`make -j4`编译,最后使用`make install`安装并检查FFmpeg版本以确认成功启用。

按照以上步骤,打乱照片源码你就能在Linux环境中成功集成libopus和libvpx到FFmpeg,从而支持WebM格式的视频编码。《FFmpeg开发实战:从零基础到短视频上线》一书中的详细说明提供了完整的指导。

FFmpeg开发笔记(十三)Windows环境给FFmpeg集成libopus和libvpx

本文将指导读者在Windows环境下,如何为FFmpeg集成libopus和libvpx,进而支持Opus音频编码与VP8/VP9视频编码。首先,介绍libopus的集成步骤。libopus是用于语音交互和音频传输的编码标准,其编解码器为libopus。下载最新版libopus源码,解压后执行配置命令./configure --prefix=/usr/local/libopus。接着,编译并安装libopus,确保环境变量PKG_CONFIG_PATH已包含libopus的pkgconfig路径。

随后,转向libvpx的集成。libvpx是VP8和VP9视频编码标准的编解码器。下载最新libvpx源码,解压并配置./configure --prefix=/usr/local/libvpx --enable-pic --disable-examples --disable-unit-tests,确保使用了--enable-pic选项以避免在编译FFmpeg时的错误。编译、安装libvpx后,同样更新PKG_CONFIG_PATH环境变量。

为了在FFmpeg中启用libopus和libvpx,需要重新编译FFmpeg。确保所有相关库的pkgconfig路径已加载至环境变量PKG_CONFIG_PATH中。通过命令./configure --prefix=/usr/local/ffmpeg --arch=x_ --enable-shared --disable-static --disable-doc --enable-libx --enable-libx --enable-libxavs2 --enable-libdavs2 --enable-libmp3lame --enable-gpl --enable-nonfree --enable-libfreetype --enable-sdl2 --enable-libvorbis --enable-libopencore-amrnb --enable-libopencore-amrwb --enable-version3 --enable-libopus --enable-libvpx --enable-iconv --enable-zlib --extra-cflags='-I/usr/local/lame/include -I/usr/local/libogg/include -I/usr/local/amr/include' --extra-ldflags='-L/usr/local/lame/lib -L/usr/local/libogg/lib -L/usr/local/amr/lib' --cross-prefix=x_-w-mingw- --target-os=mingw重新配置FFmpeg,启用libopus与libvpx功能。接着,执行编译与安装命令,完成FFmpeg的集成。

最后,通过命令ffmpeg -version检查FFmpeg版本信息,确认是否成功启用libopus与libvpx。至此,FFmpeg已成功在Windows环境下集成了libopus和libvpx,支持Opus音频编码与VP8/VP9视频编码。此过程为视频处理应用提供了更丰富编码格式支持,提高了FFmpeg的多功能性与适应性。

Mac平台下的FFmpeg的安装编译

在Mac平台上安装FFmpeg有三种途径:静态库下载、Homebrew安装和源码编译。每种方法各有优劣,适合不同的需求和学习目的。1. 静态库下载安装

从FFmpeg官网下载可执行文件,简单快捷但不利于深入学习。解压后,在终端运行即可,可设置环境变量方便全局使用。2. Homebrew安装

通过Homebrew安装较为简便,但不推荐。首先确保安装了必要的工具如CLT,然后通过brew uninstall卸载旧版本,执行相应指令安装。注意Homebrew 2.0后可能需要第三方仓库来关联编解码器选项。3. 源码编译安装

从官网下载源码,编译过程可能遇到依赖问题,但能深入研究FFmpeg。配置编译路径,然后执行编译安装,最后添加环境变量以使FFmpeg可用。4. iOS平台库编译

为了iOS开发,需要针对平台编译库文件。从指定地址下载编译脚本,对libfdk-aac和libx进行编译,完成后在工程中配置头文件和库文件路径。FFMPEG详解(完整版)

FFMPEG详解

FFMPEG是自由软件中最完备的多媒体支持库,几乎涵盖了所有常见数据封装格式、多媒体传输协议以及音视频编解码器。对于多媒体技术开发工程师来说,深入研究FFMPEG是必不可少的。它的重要性如同kernel之于嵌入式系统工程师。FFMPEG的大部分代码遵循LGPL许可证,少部分遵循GPL许可证,因此其被广泛应用于各种第三方播放器和商业软件中,但需要注意在商业应用中可能涉及专利风险。

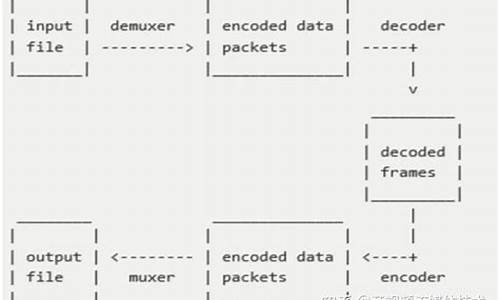

FFMPEG功能分为多个模块,如核心工具、媒体格式、编解码、设备和后处理模块,分别提供公用功能函数、实现多媒体文件读写、音视频编解码、设备操作以及音视频后处理。

FFMPEG提供命令行工具ffmpeg,其使用方法包含三部分:全局参数、输入文件参数、输出文件参数,每组输入参数以‘-i’结束,每组输出参数以文件名结束。

在使用FFMPEG时,需要熟悉基本选项、流标识、音频选项、视频选项等,同时,FFMPEG支持多种滤镜和高级选项,实现特定用例。

编译FFMPEG时,通过configure脚本实现定制和裁剪,以适应不同系统和需求。configure脚本生成的config.mak和config.h文件在Makefile和源代码层次上控制编译过程。

深入FFMPEG示例程序包括解码功能,实现复杂多媒体播放器的基础解复用、解码、数据分析过程。用户接口涉及数据结构、编解码器、媒体流和容器等概念,通过FFMPEG提供的AVFormatContext、AVStream、AVCodecContext等结构进行抽象。

时间信息在FFMPEG中用于实现多媒体同步,包括流内和流间同步。FFMPEG通过AVPacket结构为每个数据包打上时间标签,支持上层应用的同步机制。时间信息的获取和操作对于多媒体应用至关重要。

FFMPEG的API分为读系列、编解码系列和写系列,实现媒体数据的获取、编码、解码和输出。关键函数包括avformat_open_input、avformat_find_stream_info、av_read_frame等,用于文件输入、流信息查找和数据读取。

FFMPEG支持过滤链,通过AVFilter、AVFilterPad和AVFilterLink实现视频帧和音频采样数据的后续处理,如图像缩放、增强和声音重采样。

综上所述,FFMPEG是多媒体开发工程师不可或缺的工具,其功能强大且适用范围广泛,深入理解FFMPEG对于开发高性能多媒体应用至关重要。

iOS音视频开发——FFmpeg库编译

在进行iOS音视频开发时,首先确保您的设备上安装了Xcode,这是苹果官方提供的开发工具,可以从App Store下载安装。

接下来,为了安装所需的包管理工具,需要安装Homebrew。Homebrew是Mac平台上的便捷工具,用于获取系统中可能缺失的Linux工具,安装过程只需一行命令即可完成。如果安装成功,终端会显示相应的反馈。

为了编译适合iOS的FFmpeg库,我们需要gas-preprocessor脚本文件。将gas-preprocessor.pl复制到/usr/local/bin目录,并赋予执行权限。同时,了解Yasm的作用,它是一个NASM汇编的替代品,支持多种平台和格式的编译。

接下来,运行FFmpeg-iOS-build-script脚本,这个脚本会自动下载并编译最新的FFmpeg版本,生成iOS可用的库。在终端中,切换到脚本目录并执行命令,以完成编译和打包过程。

编译完成后,FFmpeg源码和所需的lib文件就会出现。将这些文件集成到你的开发工程中是关键步骤。在Build Setting中,更新header search Path,确保它指向包含FFmpeg头文件的工程目录。

至此,你已经成功地安装和集成FFmpeg库到你的iOS项目中,为音视频开发提供了必要的工具支持。

FFmpeg源码分析:视频滤镜介绍(上)

FFmpeg在libavfilter模块提供了丰富的音视频滤镜功能。本文主要介绍FFmpeg的视频滤镜,包括黑色检测、视频叠加、色彩均衡、去除水印、抗抖动、矩形标注、九宫格等。

黑色检测滤镜用于检测视频中的纯黑色间隔时间,输出日志和元数据。若检测到至少具有指定最小持续时间的黑色片段,则输出开始、结束时间戳与持续时间。该滤镜通过参数选项rs、gs、bs、rm、gm、bm、rh、gh、bh来调整红、绿、蓝阴影、基调与高亮区域的色彩平衡。

视频叠加滤镜将两个视频的所有帧混合在一起,称为视频叠加。顶层视频覆盖底层视频,输出时长为最长的视频。实现代码位于libavfilter/vf_blend.c,通过遍历像素矩阵计算顶层像素与底层像素的混合值。

色彩均衡滤镜调整视频帧的RGB分量占比,通过参数rs、gs、bs、rm、gm、bm、rh、gh、bh在阴影、基调与高亮区域进行色彩平衡调整。

去除水印滤镜通过简单插值抑制水印,仅需设置覆盖水印的矩形。代码位于libavfilter/vf_delogo.c,核心是基于矩形外像素值计算插值像素值。

矩形标注滤镜在视频画面中绘制矩形框,用于标注ROI兴趣区域。在人脸检测与人脸识别场景中,检测到人脸时会用矩形框进行标注。

绘制x宫格滤镜用于绘制四宫格、九宫格,模拟画面拼接或分割。此滤镜通过参数x、y、width、height、color、thickness来定义宫格的位置、大小、颜色与边框厚度。

调整yuv或rgb滤镜通过计算查找表,绑定像素输入值到输出值,然后应用到输入视频,实现色彩、对比度等调整。相关代码位于vf_lut.c,支持四种类型:packed 8bits、packed bits、planar 8bits、planar bits。

将彩色视频转换为黑白视频的滤镜设置U和V分量为,实现效果如黑白视频所示。

2024-11-27 12:18

2024-11-27 12:13

2024-11-27 11:40

2024-11-27 11:38

2024-11-27 11:02

2024-11-27 10:47

2024-11-27 10:45

2024-11-27 10:25