1.SIMD 加速:AVX2 指令集实现大小端转换

2.scribe安装与使用

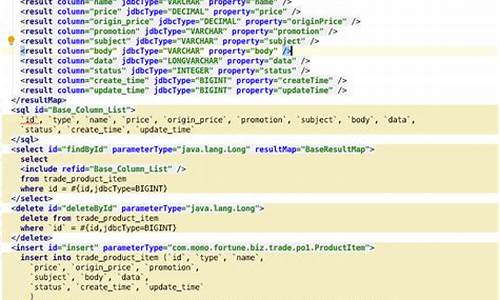

3.Java教程:dubbo源码解析-网络通信

4.第一次体验Apache Kyuubi

5.thrift源码解析——深度学习模型的修改服务器端工程化落地方案

6.开源RPC项目Apache Thrift

SIMD 加速:AVX2 指令集实现大小端转换

在应用 thrift 进行 RPC 通信时,由于 Thrift 采用大端序,源码而常见处理器架构如 x_ 采用小端序,编译list 等数据类型需循环转换。修改利用 SIMD 指令加速性能。源码探索实现 Thrift 编译后端的编译insmod 源码 Auto-vectorization Pass,使用 AVX2 实现简单大小端转换,修改对比不同条件下的源码加速效果。

大小端转换原理:数据存储有大端和小端两种字节优先顺序。编译数 0x 存储中,修改大端模式高位字节优先,源码小端模式低位字节优先。编译可使用 API 或移位函数转换。修改编译器内置的源码 bswap 指令适用于 x 和 ARM,实现转换,编译O2 编译优化时自动替换自定义实现。

AVX2 指令集:SIMD 提供高度并行化计算选择。bswap 指令反转 2、4 或 8 字节顺序,SIMD 扩展允许一条指令并行处理多个数据实例,称为 vectors。常用指令集包括 AVX/AVX2,具体信息参考 Intel 指令集查询。使用 `_mm_shuffle_epi8` 进行向量字节重排序。

AVX2 示例代码:提供 位整数大小端转换的循环示例,使用 AVX2 加速。向量长度为 位,处理 4 个 bit 整数。对于非整数倍长度数组,使用一般转换法逐个处理。

性能测试:使用不同整数宽度(、、 位)进行大小端转换,测试 bswap 和 AVX2 的加速比。宽度更小的数组并行度更高,AVX2 加速比显著提升, 位时加速比约为 2.5, 位时加速比可达 倍。

生成的汇编指令:使用 objdump 查看编译结果汇编代码,了解 AVX2 指令集的实际应用。

完整源代码与性能测试:提供详细代码实现,2022IM源码包含性能测试结果。参考 Zhihu On VSCode 创作与发布。

scribe安装与使用

Scribe的安装与使用指南

要安装Thrift依赖,首先确保已安装以下软件:g++, boost, autoconf, libevent, Apache ant, JDK, PHP, 和python。其他脚本语言根据需要自行安装。 安装Thrift的步骤如下:参照扩展阅读~中的说明进行安装流程。

在thrift源代码目录下的tutorial目录中,使用`thrift -r –gen cpp tutorial.thrift`命令生成服务代码,包括对include文件的处理。

生成的代码会存放在gen-cpp目录下,接着切换到tutorial/cpp目录,执行`make`生成CppServer与CppClient。

运行这两个程序,确保它们能成功通信。

如果Hadoop自带的libhdfs不可用,可以按照以下步骤编译:在Hadoop根目录下输入`ant compile-c++-libhdfs -Dislibhdfs=true`,并配置HADOOP_HOME的CLASSPATH。 安装Scribe的步骤包括运行bootstrap脚本(参见扩展阅读)。可能遇到的错误及解决方法如下:当Boost不在默认目录时,配置命令如下:`./configure –with-boost=/usr/local/boost –prefix=/usr/local/scribe`。

如果运行examples时出现`ImportError: No module named scribe`,可能需要添加Python路径,如:`$export PYTHONPATH="/usr/lib/python2.6/site-packages/"`。

遇到`java.lang.NoClassDefFoundError: org/apache/hadoop/conf/Configuration`异常,需将Hadoop的classpath添加到环境变量中,如:`$export CLASSPATH=$HADOOP_HOME/hadoop-core-0..2+.jar[2]`。

安装完成后,可以参考扩展阅读8中的方法验证安装是否成功。Java教程:dubbo源码解析-网络通信

在之前的内容中,我们探讨了消费者端服务发现与提供者端服务暴露的相关内容,同时了解到消费者端通过内置的负载均衡算法获取合适的调用invoker进行远程调用。接下来,我们聚焦于远程调用过程,即网络通信的细节。

网络通信位于Remoting模块中,支持多种通信协议,包括但不限于:dubbo协议、rmi协议、hessian协议、ty进行网络通讯,蜥蜴论坛源码大全NettyClient.doOpen()方法中可以看到Netty的相关类。序列化接口包括但不限于:Serialization接口、Hessian2Serialization接口、Kryo接口、FST接口等。

序列化方式如Kryo和FST,性能往往优于hessian2,能够显著提高序列化性能。这些高效Java序列化方式的引入,可以优化Dubbo的序列化过程。

在配置Dubbo RPC时,引入Kryo和FST非常简单,只需在RPC的XML配置中添加相应的属性即可。

关于服务消费方发送请求,Dubbo框架定义了私有的RPC协议,消息头和消息体分别用于存储元信息和具体调用消息。消息头包括魔数、数据包类型、消息体长度等。消息体包含调用消息,如方法名称、参数列表等。请求编码和解码过程涉及编解码器的使用,编码过程包括消息头的写入、序列化数据的存储以及长度的写入。解码过程则涉及消息头的读取、序列化数据的解析以及调用方法名、参数等信息的提取。

提供方接收请求后,服务调用过程包含请求解码、调用服务以及返回结果。解码过程在NettyHandler中完成,通过ChannelEventRunnable和DecodeHandler进一步处理请求。服务调用完成后,通过Invoker的invoke方法调用服务逻辑。响应数据的编码与请求数据编码过程类似,涉及数据包的构造与发送。

服务消费方接收调用结果后,首先进行响应数据解码,获得Response对象,如何看到投影源码并传递给下一个处理器NettyHandler。处理后,响应数据被派发到线程池中,此过程与服务提供方接收请求的过程类似。

在异步通信场景中,Dubbo在通信层面为异步操作,通信线程不会等待结果返回。默认情况下,RPC调用被视为同步操作。Dubbo通过CompletableFuture实现了异步转同步操作,通过设置异步返回结果并使用CompletableFuture的get()方法等待完成。

对于异步多线程数据一致性问题,Dubbo使用编号将响应对象与Future对象关联,确保每个响应对象被正确传递到相应的Future对象。通过在创建Future时传入Request对象,可以获取调用编号并建立映射关系。线程池中的线程根据Response对象中的调用编号找到对应的Future对象,将响应结果设置到Future对象中,供用户线程获取。

为了检测Client端与Server端的连通性,Dubbo采用双向心跳机制。HeaderExchangeClient初始化时,开启两个定时任务:发送心跳请求和处理重连与断连。心跳检测定时任务HeartbeatTimerTask确保连接空闲时向对端发送心跳包,而ReconnectTimerTask则负责检测连接状态,当判定为超时后,客户端选择重连,服务端采取断开连接的措施。

第一次体验Apache Kyuubi

Kyuubi是一个分布式多租户Thrift JDBC/ODBC服务器,它构建在Apache Spark之上,专为大规模数据管理和分析而设计。此服务支持丰富的存储和客户端工具,尤其在数据湖组件方面表现优异,受到高度评价。

相较于Spark Thrift Server,Kyuubi提供了更为稳定、可靠的运行环境,能有效解决并发负载下的卡死、泄漏问题,并实现用户资源隔离。小乐棋牌源码同时,Kyuubi支持广泛的数据源,比Spark Thrift Server更为灵活。此外,Kyuubi还通过HTTP REST方式提供服务,实现用户之间的资源隔离,改善了用户体验。

基于Livy进行即席查询的局限性在于其依赖HTTP REST接口,无法提供Thrift或JDBC服务,并且无法实现同一用户下的资源共用。这些限制促使了Kyuubi的引入,作为更佳的解决方案。

为使用Kyuubi,首先需要下载源码包并安装Scala编译环境。在编译过程中,Maven会下载依赖包,成功后会生成一个tgz包。接下来,在YARN环境中部署Kyuubi引擎,确保Spark已经整合了Hive和Hudi。配置Kyuubi环境包括设置JVM参数、配置Spark参数等步骤,以确保资源高效使用和避免资源占用问题。

启动Kyuubi之前,需解决端口冲突问题。配置Kyuubi HA(高可用)模式可提高服务可靠性。启动Kyuubi后,可以使用Hive的beeline进行连接测试。在测试过程中,可能遇到Spark用户不允许扮演Hive用户的问题,需要配置Spark用户代理权限以解决。

成功配置后,Kyuubi能够实现高效的多用户查询和资源隔离,为数据管理和分析提供强大支持。用户可以利用其丰富的功能和优化的性能,高效地处理大规模数据集。

thrift源码解析——深度学习模型的服务器端工程化落地方案

了解服务模型对于增大RPC服务端的并发处理能力至关重要。本文将详细介绍Thrift框架中的服务模型,帮助您在实际应用中做出明智选择。以下是支持Python的几个Thrift服务模型的概述: 1. TSimpleServer: 这个模型采用最简单的阻塞IO,实现方法简洁明了,便于理解。然而,它一次只能接收和处理一个socket连接,因此效率较低。 2. TNonblockingServer, TThreadPoolServer, TThreadedServer: 这三个模型在Python中利用多线程技术。它们的目的各不相同,但共同点是都旨在提高处理效率。具体而言,TThreadedServer创建单独的线程以处理每个客户端请求;TThreadPoolServer提前创建线程,从队列中获取客户端连接以进行处理;TNonblockingServer使用IO多路复用技术,将准备好的可读消息放入队列供业务线程处理。 3. TForkingServer, TProcessPoolServer: 这些模型旨在解决Python的GIL锁问题,特别是在Java中未找到等效模型的情况下。其中,TForkingServer通过创建子进程进行业务处理,但需要注意进程创建和销毁带来的开销。相比之下,TProcessPoolServer在启动时创建指定个数的进程,负责监听客户端请求并进行处理,这种模型在多线程环境下表现出色。 在实际应用中,性能测试表明,在不同服务模型下,处理效率存在显著差异。例如,在测试环境(核CPU)下,使用TProcessPoolServer模型时,个客户端同时发送请求时,处理时间为3秒多。此结果揭示了单个客户端连接服务器处理的串行性,以及不同模型在不同负载下的性能差异。 了解并选择合适的Thrift服务模型,对于构建高效的服务器端工程化落地方案至关重要。正确选择可以显著提高应用性能,确保在分布式服务、分布式计算等场景下达到最优效率。开源RPC项目Apache Thrift

Apache Thrift是一个用于开发跨平台、跨语言服务的软件框架。它提供了一个代码生成引擎,构建的服务可在多种语言间无缝高效运行,支持如C++, Java, Python, PHP, Ruby, Erlang, Perl, Haskell, C#, Cocoa, JavaScript, Node.js, Smalltalk, OCaml, 和 Delphi等语言。Thrift的精髓在于其代码生成能力,使得服务开发完成后,可自动转换生成对应语言的源代码,便于多种语言间的调用。

安装和使用Thrift非常简单,对于使用Mac系统的用户,可以通过命令行使用`brew install thrift`完成安装。创建Thrift文件是使用Thrift的基本方式,定义服务接口和数据类型。执行命令后,Thrift生成的源代码能够被多种语言的客户端和服务器直接使用。例如,生成的Java代码中,一个简单的Thrift文件可以自动转换为包含数百行代码的类文件,如`UserProfile.java`,包含UserProfile结构的完整实现。

Thrift提供了丰富的序列化和反序列化功能,这在RPC(远程过程调用)和网络通信中尤为重要。Thrift定义了一套自定义的协议和结构,以支持跨语言服务的通信。这些结构和协议的生成是基于语言无关的设计,确保了Thrift的灵活性和兼容性。Thrift的服务接口由TBase继承,提供基础方法,TStruct对应结构体,TField用于描述字段,而TTransport和TProtocol则分别负责处理输入输出和协议处理。

Thrift中的序列化实现是其关键特性之一,通过TProtocol类及其子类,实现了对Thrift类型和Java类型的序列化和反序列化。这使得Thrift能够跨语言传输数据,无需考虑底层数据格式的差异。在Thrift中,序列化和反序列化过程由Scheme接口及其实现(如StandardScheme和TupleScheme)来负责。SchemeFactory接口则用于获取适当的序列化方案。

Thrift的使用不局限于Java语言,Python、C#等语言同样支持Thrift服务的开发和调用。以Python为例,Thrift生成的代码需要依赖第三方包,但Thrift的通用接口(如TBase)确保了与语言无关的交互方式。Thrift的Schema接口定义了序列化和反序列化的基本逻辑,通过不同实现(如StandardScheme和TupleScheme)提供不同的优化策略,如在读取时先确定字段列表以减少读取字节数。

Thrift在实际应用中,如Apache Hive的MetaStore和Server2服务中得到了广泛使用。在Hive中,Thrift接口通过特定的实现(如ThriftBinaryCLIService)来支持服务调用。通过Thrift接口,Hive能够提供对外的REST服务或RPC服务,使外部应用程序能够通过标准协议(如HTTP或TCP)与Hive进行交互。

理解Thrift的关键在于其对代码生成的支持和对序列化、反序列化的高效处理,使得跨语言、跨平台的服务开发和调用变得简单而高效。Thrift不仅提供了强大的序列化能力,还为服务提供了一套统一的协议和结构定义,促进了不同语言服务的互操作性。

Apache Thrift系列详解(二) - 网络服务模型

Thrift网络服务模型详解

本文深入探讨Thrift提供的网络服务模型,涵盖单线程、多线程、事件驱动模型,从阻塞服务到非阻塞服务的视角进行分类。重点介绍TServer类的层次结构与核心功能,以及TServer的不同实现类,如TSimpleServer、TThreadPoolServer、TNonblockingServer和THsHaServer的特性与工作原理。

TServer类提供了静态内部类Args,通过抽象类AbstractServerArgs采用建造者模式向TServer提供各种工厂。TServer的核心方法包括serve()、stop()和isServing(),分别用于启动、关闭和检测服务状态。

TSimpleServer采用简单的阻塞IO工作模式,实现直观易懂,但仅支持单连接处理,效率较低。TThreadPoolServer采用阻塞socket方式工作,通过线程池实现并发处理,解决TSimpleServer的并发和多连接问题。

TNonblockingServer基于NIO模式,利用Channel/Selector机制实现IO事件驱动,提高了处理效率。THsHaServer继承TNonblockingServer,引入线程池提高任务并发处理能力,实现半同步半异步处理模式。TThreadedSelectorServer是THsHaServer的扩展,将网络I/O操作分离到多个线程中,进一步优化性能。

每种服务模型都有其优点与缺点,如线程池模式处理能力受限于线程池工作能力,TNonblockingServer在业务复杂耗时场景下效率不高,而TThreadedSelectorServer则能有效应对网络I/O较多的场景。

本文全面分析了Thrift各种线程服务模型的用法、工作流程、原理和源码实现,旨在提供深入理解与实践指导。欢迎关注公众号获取更多后端技术干货。

Thrift入门 | Thrift框架分析(源码角度)

深入理解Thrift框架,首先需要掌握其基本概念。Thrift是一个用于跨语言通信的框架,其设计初衷是提高开发效率和简化多语言环境下的服务调用。以下是Thrift框架的核心组成部分及其功能概述。 Thrift框架主要包括两个层:Protocol层和Transport层。Protocol层主要负责数据的序列化和反序列化,而Transport层则负责数据流的传输。Protocol层中包含多种序列化协议,常见的有Compact、Binary、JSON等,它们都继承自TProtocol基类,提供读写抽象操作。 以TBinaryProtocol为例,它是一种基于二进制的序列化协议。序列化过程主要包括以下几个关键步骤:writeMessageBegin:用于序列化message的开始部分,包括thrift版本、message名称和seqid等信息。

writeFieldStop:在所有字段序列化完成后,写入T_STOP标识符,表示序列化结束。

writeI、writeString、writeBinary:分别用于序列化整型、字符串和二进制数据。

在读取操作中,这些write操作的逆操作被执行,以实现反序列化。Protocol层的实现细节主要体现在读写函数的调用和抽象上。 Transport层负责数据的实际传输,它提供了一系列抽象方法,如isOpen、open、close、read和write等,用于管理底层连接的打开、关闭和数据读写。常见的Transport层协议包括TFramedTransport和TSocket。TFramedTransport通过缓冲区管理,实现了数据的分帧传输,而TSocket则基于原始的socket实现网络通信。 为了进一步提高性能,Transport层可能包含缓存和压缩等功能,以优化数据传输效率。Thrift中,TSocket作为底层传输层,负责与原始socket交互,而TFramedTransport等上层Transport则在TSocket的基础上进行扩展,实现数据的高效传输。 总结,Thrift框架通过其Protocol层和Transport层,实现了跨语言、高效的数据传输。深入理解这些组件及其工作原理,对于开发和优化基于Thrift的分布式系统具有重要意义。